模型训练需要的几个基础部分包括:数据、模型、优化器、损失函数,这四个部分通过迭代不断让模型学习到输入到输出的映射关系。

数据

PyTorch有两个主要的处理数据的模块,torch.utils.data.DataLoarder 和torch.utils.data.Dataset。Dataset 存储样本及其对应的标签,DataLoader 对数据集封装了一个迭代器。

import torch

import torch.nn as nn

from torch.utils.data import DataLoader

from torchvision import datasets

from torchvision.transforms import ToTensorPyTorch提供了特定领域的库,如TorchText、TorchVision和TorchAudio,这些库都包含数据集。此文将使用TorchVision数据集。

torchvision.datasets 模块包含许多真实世界视觉数据的数据集对象,如CIFAR和COCO。在此使用FashionMNIST数据集。每个TorchVision数据集都包含两个参数:transform和target_transform,分别用于修改样本和标签。

# Download training data from open datasets.

training_data = datasets.FashionMNIST(

root="data",

train=True,

download=True,

transform=ToTensor(),

)

# Download test data from open datasets.

test_data = datasets.FashionMNIST(

root="data",

train=False,

download=True,

transform=ToTensor(),

)将 Dataset 作为参数传递给 DataLoader。它对数据集包装了一个迭代器,并支持自动批处理(batching)、采样(sampling)、混洗(shuffling)和多进程数据加载(multiprocess data loading)。在这里,batch size定义为64,即dataloader迭代器中的每个元素将返回64个特征和标签。

batch_size = 64

# Create data loaders.

train_dataloader = DataLoader(training_data, batch_size=batch_size)

test_dataloader = DataLoader(test_data, batch_size=batch_size)

for X, y in test_dataloader:

print(f"Shape of X [N, C, H, W]: {X.shape}")

print(f"Shape of y: {y.shape} {y.dtype}")

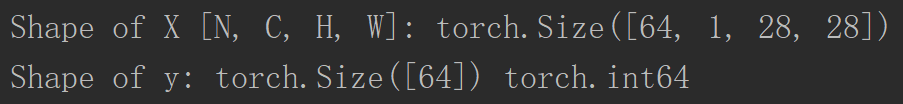

break上述代码输出结果为:

模型

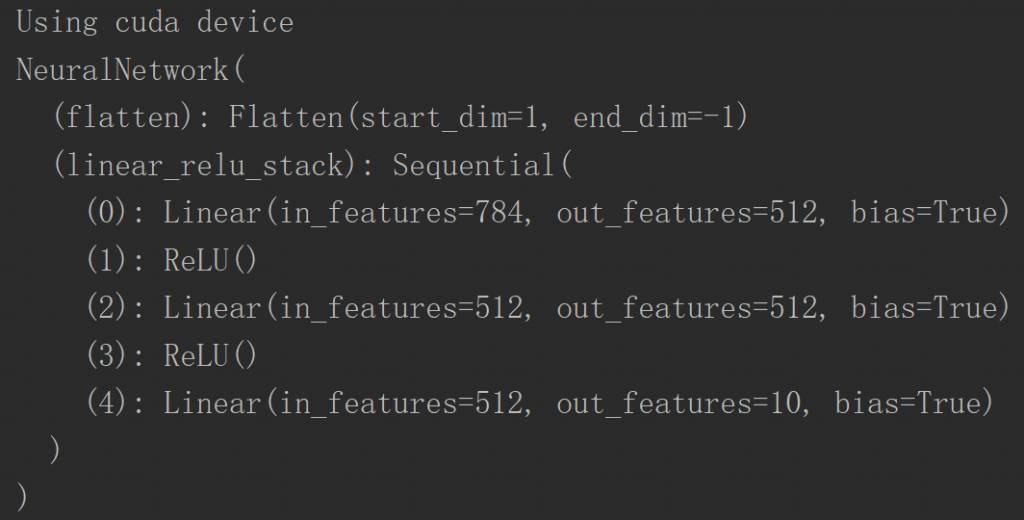

要在PyTorch中定义神经网络,需要创建一个继承 nn.Module 的类。在 __init__ 函数中定义网络的层,并在 forward 函数中指定数据如何通过网络。为了加速神经网络的操作,如果GPU可用的话,可以将其移动到GPU。

# Get cpu or gpu device for training.

device = "cuda" if torch.cuda.is_available() else "cpu"

print(f"Using {device} device")

# Define model

class NeuralNetwork(nn.Module):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.linear_relu_stack = nn.Sequential(

nn.Linear(28*28, 512),

nn.ReLU(),

nn.Linear(512, 512),

nn.ReLU(),

nn.Linear(512, 10)

)

def forward(self, x):

x = self.flatten(x)

logits = self.linear_relu_stack(x)

return logits

model = NeuralNetwork().to(device)

print(model)上述代码的输出结果:

优化模型参数

为了训练模型,需要一个损失函数(loss function)和一个优化器(optimizer)。

loss_fn = nn.CrossEntropyLoss()

optimizer = torch.optim.SGD(model.parameters(), lr=1e-3)在单个训练循环中,模型对训练数据集进行预测(分批输入),并反向传播预测误差以调整模型的参数。

def train(dataloader, model, loss_fn, optimizer):

size = len(dataloader.dataset)

model.train()

for batch, (X, y) in enumerate(dataloader):

X, y = X.to(device), y.to(device)

# Compute prediction error

pred = model(X)

loss = loss_fn(pred, y)

# Backpropagation

optimizer.zero_grad()

loss.backward()

optimizer.step()

if batch % 100 == 0:

loss, current = loss.item(), batch * len(X)

print(f"loss: {loss:>7f} [{current:>5d}/{size:>5d}]")还根据测试数据集检查模型的性能,以确保模型是在学习。

def test(dataloader, model, loss_fn):

size = len(dataloader.dataset)

num_batches = len(dataloader)

model.eval()

test_loss, correct = 0, 0

with torch.no_grad():

for X, y in dataloader:

X, y = X.to(device), y.to(device)

pred = model(X)

test_loss += loss_fn(pred, y).item()

correct += (pred.argmax(1) == y).type(torch.float).sum().item()

test_loss /= num_batches

correct /= size

print(f"Test Error: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")训练过程经过多次迭代(epoch)。在每个epoch期间,模型学习参数以做出更好的预测。打印模型在每个epoch的精度(accuracy)和损失(loss);希望看到精度随着每次迭代而增加,损失减少。

epochs = 5

for t in range(epochs):

print(f"Epoch {t+1}\n-------------------------------")

train(train_dataloader, model, loss_fn, optimizer)

test(test_dataloader, model, loss_fn)

print("Done!")Epoch 1 Test Error: Accuracy: 45.2%, Avg loss: 2.149141

Epoch 2 Test Error: Accuracy: 51.7%, Avg loss: 1.872434

Epoch 3 Test Error: Accuracy: 59.0%, Avg loss: 1.519363

Epoch 4 Test Error: Accuracy: 62.4%, Avg loss: 1.262601

Epoch 5 Test Error: Accuracy: 64.3%, Avg loss: 1.098800

保存模型

保存模型的常用方法是序列化内部状态字典(包含模型参数)。

torch.save(model.state_dict(), "model.pth")

print("Saved PyTorch Model State to model.pth")加载模型

加载模型的过程包括重新创建模型结构并将状态字典加载到其中。

model = NeuralNetwork()

model.load_state_dict(torch.load("model.pth"))这个模型现在可以用来进行预测。

classes = [

"T-shirt/top",

"Trouser",

"Pullover",

"Dress",

"Coat",

"Sandal",

"Shirt",

"Sneaker",

"Bag",

"Ankle boot",

]

model.eval()

x, y = test_data[0][0], test_data[0][1]

with torch.no_grad():

pred = model(x)

predicted, actual = classes[pred[0].argmax(0)], classes[y]

print(f'Predicted: "{predicted}", Actual: "{actual}"')